AIReady Kubernetes

AI 모델 배포와 데이터 처리, 쿠버네티스로 안정적 운영

AI 워크로드를 쿠버네티스 환경에서 자동화, 확장, 모니터링합니다. 컨테이너 기반 배포와 멀티 스레드 처리로 빠른 데이터 수집과 모델 추론이 가능하며, 무중단 서비스와 리소스 최적화를 동시에 제공합니다.

AI를 위한 쿠버네티스(K8S) Ops

쿠버네티스 기반 AI 인프라는 컨테이너 오케스트레이션을 통해 자동화, 확장성, 안정성을 제공합니다. AI 모델 배포와 스케일링, 멀티 스레드 환경에서의 빠른 데이터 처리까지 지원합니다.

K8s의 장점

- 자동 스케일링: AI 워크로드 증가 시 파드 자동 확장

- 컨테이너 기반 배포: 모델 업데이트/배포 자동화

- 멀티 테넌트 지원: 여러 프로젝트/팀 환경 분리

- 무중단 서비스: Rolling update, Rollback 기능

- 모니터링 및 로깅: Prometheus, Grafana 기반 실시간 관제

- 리소스 최적화: 멀티 스레드 기반 연산 및 GPU/CPU 자원 효율적 관리

활용 사례

- 모델 훈련 자동화: 분산 훈련 환경 구축으로 훈련 시간 단축

- 모델 서빙 및 추론: 실시간 추론 서비스 및 트래픽 기반 자동 확장

- 데이터 파이프라인 관리: 수집, 전처리, 저장, 분석까지 안정적 운영

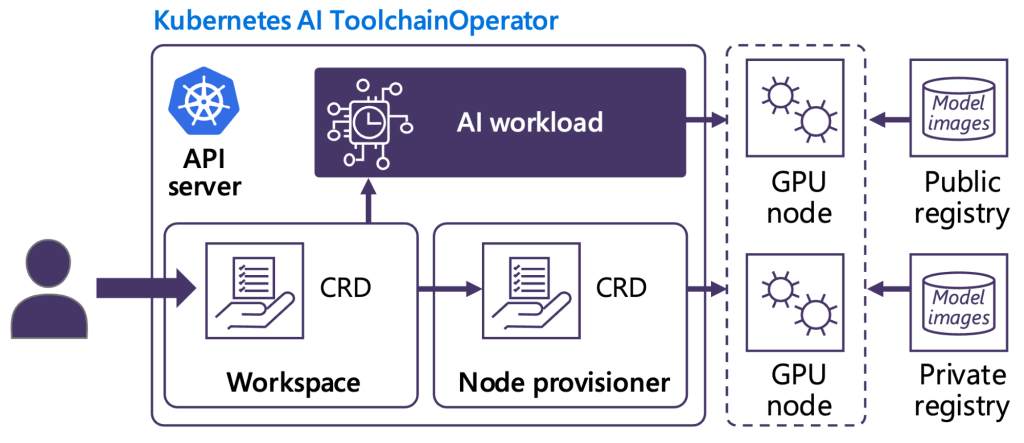

쿠버네티스 아키텍처

마스터 노드와 워커 노드로 구성되며, 컨트롤 플레인, API 서버, 스케줄러, 컨테이너 런타임, etcd 등을 포함하여 분산 환경에서 안정적인 서비스 운영을 지원합니다.

주요 장점

자동 배포/스케일링, 무중단 업데이트, 멀티 테넌트 지원, 리소스 최적화를 통해 AI 워크로드와 다양한 서비스에 최적화된 인프라를 제공합니다.

업체 인기 이유

클라우드 네이티브 환경과 잘 맞고, 멀티 클라우드와 온프레미스 모두 지원하며, 대규모 서비스 운영과 DevOps 연계가 쉬워 기업에서 많이 채택합니다.

최근 트렌드

AI/ML 파이프라인 자동화, GitOps 기반 CI/CD 통합, 서버리스 & 이벤트 기반 아키텍처, 멀티 클러스터 운영, GPU/AI 워크로드 최적화 등 최신 기술 적용이 활발합니다.